社会人博士初めてになりますが、DCASE(Workshop on Detection and Classification of Acoustic Scenes and Events)という国際学会に参加してきました。

この学会は、今はやりのAIやディープラーニングといった技術を使って、音のデータから周囲の環境を理解するという目的のもと行われております。

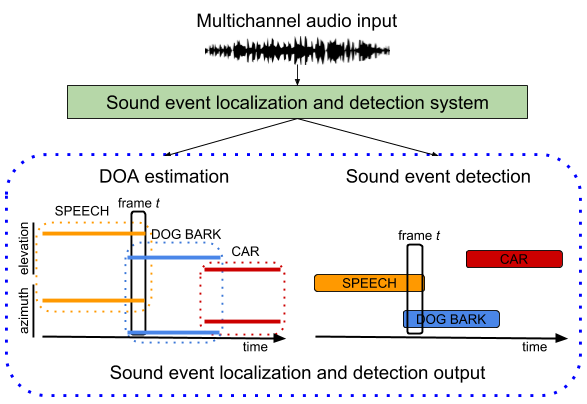

具体的には、「いつどの方向から何の音がなっているか?」といったことがAIでわかるようになります。

参加者は、企業100人、大学100人ほどの規模ですが、年々規模は大きくなっているようです。

40件ほどのポスター発表がありましたが、採択率は66%だったようです。

ここからは専門的な話になりますが、技術動向としては以下の通りでした。

・アンサンブル学習に支配されている。ほとんどがCNNベースのネットワーク。

・augumentation mixup が一般的になった

・Logmel energy waveform QCTが主に特徴量として使われている

科学としての新規性というよりかは、性能を上げるためには、アンサンブル学習やデータオーギュメンテーションといった手法がMUSTになっているようでした。この傾向はkaggleというオープンなデータサイエンスコンペでも同様なようです。